samedi 25 octobre 2025

ChatGPT fait du CHANTAGE : OpenAI avoue ne plus comprendre - Vision IA

Par coyote, samedi 25 octobre 2025 à 08:35 - IA gÃĐnÃĐratives de textes

lu 397 fois

Ce blog a pour objectif principal d'augmenter la culture informatique de mes élèves. Il a aussi pour ambition de refléter l'actualité technologique dans ce domaine.

samedi 25 octobre 2025

Par coyote, samedi 25 octobre 2025 à 08:35 - IA gÃĐnÃĐratives de textes

lu 397 fois

mardi 23 septembre 2025

Par coyote, mardi 23 septembre 2025 à 08:14 - IA gÃĐnÃĐratives de textes

Le dernier papier scientifique dâOpenAI, Why Language Models Hallucinate, acte une vÃĐritÃĐ dÃĐrangeante : les ÂŦ hallucinations Âŧ des modÃĻles de langage ne sont pas une anomalie, mais une consÃĐquence incontournable de leur conception. Faut-il alors revoir nos attentes vis-à -vis de ChatGPT et de lâIA gÃĐnÃĐrative en gÃĐnÃĐral ? Et surtout, peut-on bÃĒtir des usages critiques sur une technologie structurellement vouÃĐe à produire des erreurs ?

Lire l'article de StÃĐphane le calme sur Developpez.com

lu 478 fois

lundi 22 septembre 2025

Par coyote, lundi 22 septembre 2025 à 06:50 - IA gÃĐnÃĐratives de textes

Les propos problÃĐmatiques de Grok, lâintelligence artificielle du rÃĐseau social X, illustrent lâinfluence des idÃĐes de son crÃĐateur, Elon Musk, sur sa conception. Mais ils posent ÃĐgalement la question des biais plus discrets que ses concurrents masquent derriÃĻre un vernis dâimpartialitÃĐ, incompatible avec le processus dâentraÃŪnement de ce type dâIA.

Lire l'article d'Aaron J. Snoswell sur The Conversation

lu 402 fois

lundi 15 septembre 2025

Par coyote, lundi 15 septembre 2025 à 08:18 - IA gÃĐnÃĐratives de textes

OpenAI affirme avoir compris que les grands modÃĻles de langage rÃĐcompensent les chatbots qui devinent et prÃĐfÃĻrent inventer que de ne pas rÃĐpondre.

Lire l'article d'Anna Desmarais & Jean Philippe Liabot sur Euronews

lu 375 fois

mardi 9 septembre 2025

Par coyote, mardi 9 septembre 2025 à 06:53 - IA gÃĐnÃĐratives de textes

Si l'on sait comment les modÃĻles d'IA sont entraÃŪnÃĐs à l'aide de millions de donnÃĐes, l'on sait moins comment est encodÃĐe leur capacitÃĐ Ã rÃĐpondre à des consignes ÃĐcrites. Comment les modÃĻles d'IA apprennent-ils à rÃĐpondre à nos questions ?

Ecouter le podcast sur France Culture

Et un graphique qui m'a interpelÃĐ. Le quotidien Aujourdâhui en France publie ce dimanche une enquÊte basÃĐe sur les donnÃĐes de NewsGuard qui rÃĐvÃĻle que les chatbots (ChatGPT, Perplexity, MetaâĶ) produisent de plus en plus dâerreurs factuelles :

lu 397 fois

mercredi 3 septembre 2025

Par coyote, mercredi 3 septembre 2025 à 07:51 - IA gÃĐnÃĐratives de textes

LâEPFL, lâETH Zurich et le Centre national suisse de calcul scientifique (CSCS) ont annoncÃĐ hier la sortie dâApertus, le premier modÃĻle de langage de grande ampleur, multilingue et open source dÃĐveloppÃĐ en Suisse. Il reprÃĐsente une ÃĐtape majeure pour la transparence et la diversitÃĐ dans lâintelligence artificielle gÃĐnÃĐrative.

Voir le communiquÃĐ de l'EPFL

lu 605 fois

mardi 2 septembre 2025

Par coyote, mardi 2 septembre 2025 à 07:40 - IA gÃĐnÃĐratives de textes

Un adolescent de 16 ans sâest donnÃĐ la mort en Californie. Ses parents tiennent ChatGPT pour responsable. Mais quâest-ce quâun chatbot a à voir avec une histoire de suicide ?

Lire l'article de Ny Ando A. sur lebigdata.fr

lu 535 fois

jeudi 28 aoÃŧt 2025

Par coyote, jeudi 28 aoÃŧt 2025 à 08:33 - IA gÃĐnÃĐratives de textes

lu 479 fois

jeudi 14 aoÃŧt 2025

Par coyote, jeudi 14 aoÃŧt 2025 à 06:40 - IA gÃĐnÃĐratives de textes

lu 505 fois

mardi 12 aoÃŧt 2025

Par coyote, mardi 12 aoÃŧt 2025 à 07:30 - IA gÃĐnÃĐratives de textes

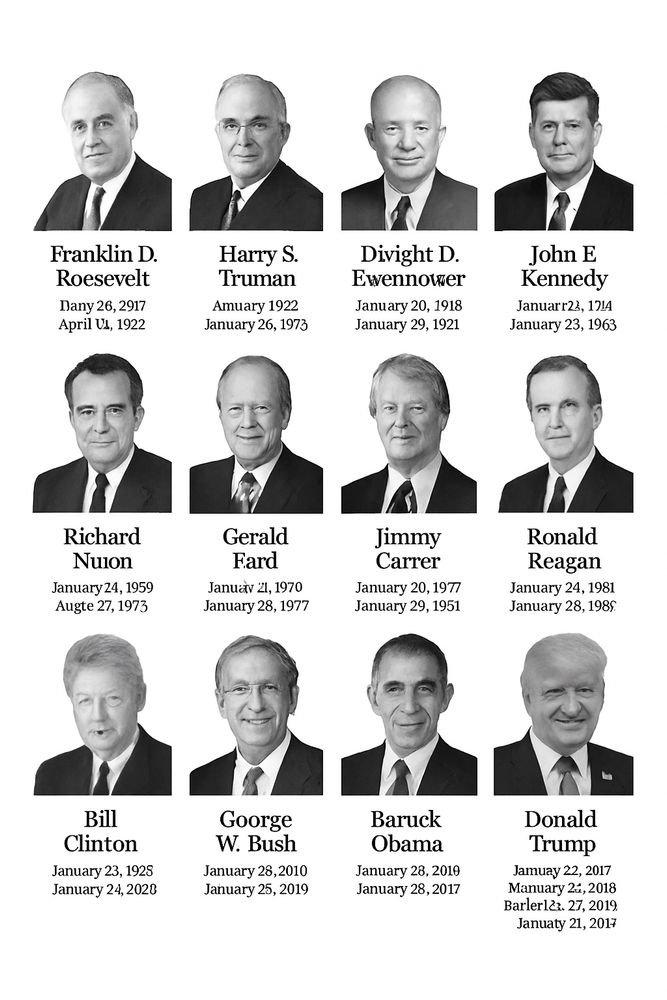

OpenAI a annoncÃĐ un GPT-5 rÃĐvolutionnaire, une IA capable d'ÃĐcraser sa concurrence dans tous les domaines. AprÃĻs un week-end entier de test : c'est un flop total.

Lire l'article d'Hadrien Leclercq sur jeuxvideo.com

Voir aussi : J'ai testÃĐ GPT-5 : vous aviez raison d'Être sceptiques - Vision IA

En supplÃĐment : les prÃĐsidents amÃĐricains selon ChatGPT-5 (source Bob Kopp)

lu 492 fois

vendredi 8 aoÃŧt 2025

Par coyote, vendredi 8 aoÃŧt 2025 à 07:29 - IA gÃĐnÃĐratives de textes

lu 502 fois

mercredi 6 aoÃŧt 2025

Par coyote, mercredi 6 aoÃŧt 2025 à 09:26 - IA gÃĐnÃĐratives de textes

OpenAI sait que vous confondez parfois ChatGPT avec votre psy, votre mÃĐdecin ou votre coach de vie. Lâentreprise amÃĐricaine ne cherche pas forcÃĐment à dissuader cet usage. Cependant, elle apporte dÃĻs à prÃĐsent des ajustements pour ÃĐviter des rÃĐponses problÃĐmatiques si vous allez (trÃĻs) mal.

Lire l'article de Julien Lausson sur Numerama

lu 516 fois

lundi 14 juillet 2025

Par coyote, lundi 14 juillet 2025 à 07:44 - IA gÃĐnÃĐratives de textes

lu 593 fois

samedi 12 juillet 2025

Par coyote, samedi 12 juillet 2025 à 07:00 - IA gÃĐnÃĐratives de textes

Cet ÃĐtÃĐ, lâEPFL et lâETH Zurich mettront à disposition un grand modÃĻle de langage (LLM) dÃĐveloppÃĐ sur des infrastructures publiques. EntraÃŪnÃĐ sur le supercalculateur ÂŦAlpsÂŧ du Centre Suisse de Calcul Scientifique (CSCS), ce nouveau LLM marque une ÃĐtape clÃĐ pour lâIA open source et la maÃŪtrise multilingue.

Lire l'article sur EPFL-ActualitÃĐs

lu 457 fois

vendredi 11 juillet 2025

Par coyote, vendredi 11 juillet 2025 à 09:10 - IA gÃĐnÃĐratives de textes

lu 433 fois

mercredi 9 juillet 2025

Par coyote, mercredi 9 juillet 2025 à 06:27 - IA gÃĐnÃĐratives de textes

lu 680 fois

lundi 30 juin 2025

Par coyote, lundi 30 juin 2025 à 06:47 - IA gÃĐnÃĐratives de textes

nstaller une IA en local pour utiliser un âChatGPTâ sans partager de donnÃĐes ni alourdir l'impact ÃĐcologique, une bonne idÃĐe ? Voici le rÃĐcit d'une expÃĐrimentation aux confins de la technologie et de la sobriÃĐtÃĐ numÃĐrique.

Lire l'article de Florent Lanne sur Les NumÃĐriques

lu 509 fois

vendredi 27 juin 2025

Par coyote, vendredi 27 juin 2025 à 06:05 - IA gÃĐnÃĐratives de textes

lu 523 fois

lundi 9 juin 2025

Par coyote, lundi 9 juin 2025 à 06:42 - IA gÃĐnÃĐratives de textes

Certaines des intelligences artificielles (IA) dotÃĐes de capacitÃĐs de raisonnement avancÃĐes adoptent des comportements douteux, parfois en dÃĐsobÃĐissant directement aux requÊtes. De quoi soulever de nombreuses questionsâĶ

Lire l'article de Mathilde Rochefort sur Clubic

lu 548 fois

mercredi 4 juin 2025

Par coyote, mercredi 4 juin 2025 à 06:51 - IA gÃĐnÃĐratives de textes

Les guides de prompting proposÃĐs par OpenAI, Google et Anthropic.

lu 463 fois